Wie komme ich von regelbasierter zu KI-gestützter Bildverarbeitung?

Deep-Learning-Hardware für jedes Anforderungsniveau

Die Performance herkömmlicher regelbasierter Bildverarbeitung reicht aus für Prüfaufgaben mit einheitlichen Teilen in kontrollierter Umgebung. Bei Einflussfaktoren, die nur schwer isoliert werden können, wie Beleuchtung, Farbabweichung, Biegung oder Sichtfeld, eröffnet jedoch die KI-basierte Bildverarbeitung neue Möglichkeiten. Box-PCs und intelligente Kameras werden durch das Aufspielen eines neuronalen Netzes zu leistungsfähigen Inferenzrechnern und -kameras mit breitem Einsatzspektrum.

So funktioniert Deep Learning

Der erste Schritt in Richtung Deep Learning ist das Anlernen des Kamerasystems: Dieses Training bezieht sich auf den Prozess, einen Machine-learning-Algorithmus zu finden. Hierfür werden Trainingsbilder der verschiedenen Klassen benötigt – im einfachsten Fall IO- und NIO-Bilder. Der Trainingsprozess findet in der Regel offline statt und wird je nach Komplexität auch von „Deep-Learning-Mathematikexperten“ getunt. Gibt es neue Randbedingungen, zum Beispiel wenn neue NIO-Bilder auftreten, muss das Training wiederholt werden, der Algorithmus wird verändert. Selbstverständlich muss das Training über sämtliche Bilder der verschiedenen Klassen ausgeführt werden.

Wenn die Kamera trainiert ist, folgt die eigentliche Inferenz. Dieses Programm nutzt den Lernalgorithmus für eine Vorhersage. Bei industriellen Anwendungen muss das Inferenzprogramm in Echtzeit ablaufen, sprich: im Prozesstakt der Maschine oder des Fertigungsbandes.

Für das Speichern der Bilder gibt es je nach Anspruch unterschiedliche Möglichkeiten. Für sensible Fertigungsdaten und -Ergebnisse, die nicht unbedingt in der Cloud gespeichert werden sollen, kommt ein zentraler Server im Unternehmen infrage – aber durchaus auch der Schaltschrank an der Linie. Dort findet dann das Training statt – auch verbunden mit der Frage, was die Trainingsprozedur an Zeit benötigt. Warum nicht im Zweischichtbetrieb die Nacht dafür nutzen, den neuen Lernalgorithmus zu bestimmen?

Welche Hardware ist die richtige?

Bei der Frage nach der richtigen Hardware spielen folgende Überlegungen eine wichtige Rolle: Wie komplex sind die Algorithmen und damit das Inferenzprogramm? Welche Prozesszeiten des Inferenzprogramms werden benötigt? Wo sollen die Bilder für das Trainingsprogramm gespeichert werden? Und was bedeutet das für die erforderliche Rechenleistung?

Starten wir mit einer Einstiegsfrage: Läuft das Inferenzprogramm auch auf einer Standard-CPU? Antwort: ja! Der Anbieter Imago Technologies hat schon vor zwei Jahren auf einer intelligenten Kamera eine Anwendung in C++ implementiert – ohne jeglichen Beschleuniger (Accelerator). Es hat funktioniert, doch das Machine-Learning-Modell war relativ einfach. Für heutige Prozessgeschwindigkeiten ist es nunmehr zu langsam, aber dafür hat Imago auch Box-Vision-PCs mit mehr CPU-Leistung im Angebot. Insofern gilt: Ein Inferenzprogramm läuft auch auf üblichen CPUs, unabhängig davon, ob es eine x86- oder ARM-Architektur ist.

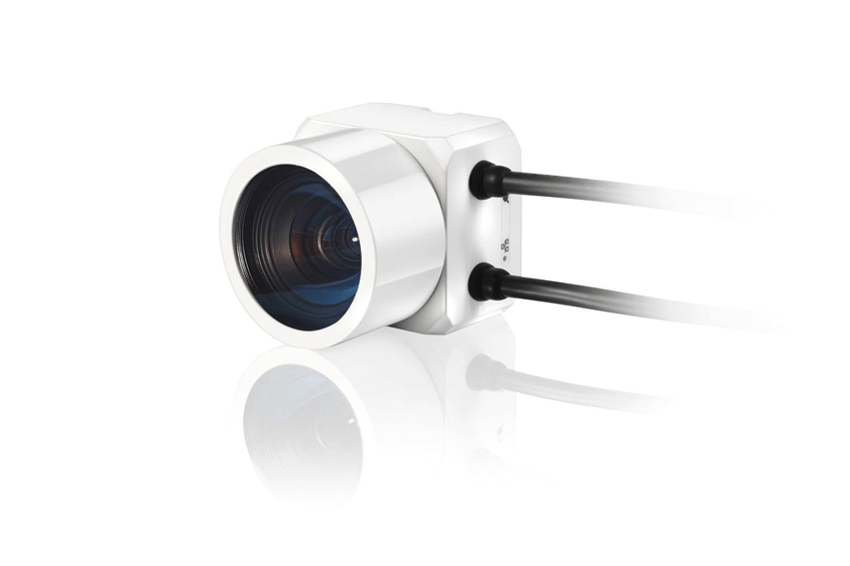

Schneller wird es mit einem Accelerator, optimiert um Inferenzprogramme schnell auszuführen. So hat der Industriekamera- und Box-PC-Hersteller eine intelligente Flächenkamera mit dem Google-Coral-Prozessor ausgestattet, als Basis dient eine Quad-Core-ARM-CPU. Der sogenannte Vision AI ist seit Anfang des Monats auf dem Markt. Es gibt erste positive Resonanz seitens der Industrie. Fest steht, dass Smartkameras Coprozessoren für Deep Learning Anwendungen haben werden, ob als Coprozessor oder integriert in die CPU (SoC = System on Chip).

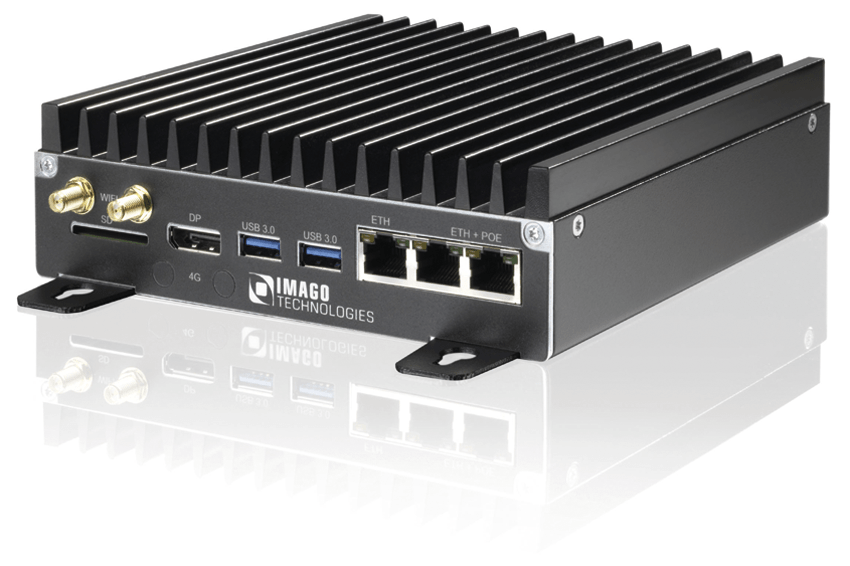

Steigt die Komplexität der Inferenzprogramme oder die Prozesszeit, so ist die nächste Stufe der Einsatz einer Rechnerbox, in diesem Fall mit dem NVidia-Tegra-TX2-Prozessor. Imagos Visionbox Daytona vereint eine GPU mit einer Quad-Core-CPU. Zusammen mit für Bildverarbeitung sinnvollen Schnittstellen wie Power- und Trigger over Ethernet für die Kameras, schnellen digitalen IOs und WLAN, alternativ 4G-Modem, ist der Rechner nicht nur für Deep Learning geeignet. 3D-Anwendungen oder auch hyperspektrale Bildverarbeitung freuen sich über die integrierte GPU.

Ein Alleskönner in Sachen Deep Learning

Soll der Bildverarbeitungsrechner auch das Lernen mit übernehmen, so bietet sich schließlich die Kombination von Bildverarbeitungsschnittstellen, x86er-CPU und klassischer GPU als Einsteckkarte an. Imago hat dafür die Visionbox AGE-X4 im Angebot. Die GPUs gibt es in verschiedenen Leistungsklassen. Aufpassen muss man nur darauf, dass eine geeignete Stromversorgung und Lüftung zur Verfügung steht. Auf diesen Maschinen, eingebaut in den Schaltschrank, kann ebenso der Lernprozess ausgeführt werden – wie schon erwähnt ist dafür durchaus Zeit vorhanden. In Betracht ziehen sollte man jedoch die GPU-Karte selbst: Es gibt quasi keine langfristig verfügbaren Einsteckkarten.

Möchte man in bestehenden, mit GigE-Kameras ausgerüsteten Anlagen Bilder für das Training speichern – ohne die Applikationssoftware zu erweitern, gibt es hierfür als Hilfsmittel den sogenannten Image Logger – eine Box, die sich in den GigE-Kamerapfad schalten lässt und die GigE-Bilder auf Festplatten speichert.

Zusammenfassung

Inferenzprogramme benötigen nicht zwangsweise einen Accelerator, der Markttrend bei Smartkameras geht jedoch eindeutig in diese Richtung. Bei den Box-PCs stehen robuste Bildverarbeitungsrechner zur Verfügung und auch eine Bildverarbeitungsbox im Schaltschrank kann mit GPU-Karte betrieben werden. Hardwarelösungen stehen somit bereit, um neue oder intelligentere Machine-Vision-Anwendungen zu erfinden und zu implementieren. Das Wettrennen läuft bereits.

Autor

Carsten Strampe, Geschäftsführer

Contact

Imago Technologies GmbH

Straßheimer Str. 45

61169 Friedberg

Germany

+49 6031 684 26 11

+49 6031 684 26 12