Dieser Roboter steht Ihnen aber gut!

Über das Phänomen der Wearable Social Robots

Prof. Dr. Oliver Bendel

1. Einleitung

Soziale Roboter sind sensomotorische Maschinen, die entwickelt wurden, um mit Menschen oder Tieren zu interagieren (Hegel et al. 2009; Bendel 2021b). Sie lassen sich anhand von fünf Dimensionen definieren: Interaktion mit Lebewesen, Kommunikation mit Lebewesen, Nähe zu Lebewesen, Abbildung von (Aspekten von) Lebewesen und – im Zentrum – Nutzen für Lebewesen (Bendel 2021b). Soziale Roboter sind häufig humanoid (menschenähnlich) oder animaloid (tierähnlich) gestaltet – dies entspricht der Dimension der Abbildung. Sie kommen beispielsweise in Pflege und Therapie, in der Bildung sowie zur Unterhaltung zum Einsatz.

Seit den 2010er-Jahren sind mehrere soziale Roboter auf den Markt gekommen, die sehr klein, aber äußerst leistungsfähig sind (Bendel 2021b, 2025c). Man kann sie mit sich herumtragen – zu Hause, aber auch in der Schule, an der Universität und bei der Arbeit oder einfach beim Spaziergang. Dies wird durch die Modelle der 2020er-Jahre erleichtert, die nicht zwingend mit dem Internet verbunden sein müssen und die man an einer Halskette oder an der Kleidung tragen kann. Man kann vom neuen Phänomen der Wearable Social Robots (der tragbaren sozialen Roboter) sprechen und sie entweder als besondere Wearable Robots oder als besondere soziale Roboter (engl. „social robots“) einordnen (Bendel 2025c).

Der soziale Roboter, der einen ständig begleitet, bedeutet einen Wechsel in der Nutzung durch den Besitzer und in der Wahrnehmung durch den Besitzer und seine Umwelt (Matsunaga und Shiomi 2021). Er kann seine Umwelt analysieren und evaluieren und mit ihr in Kontakt treten, und er kann seine Erkenntnisse mit dem Besitzer oder anderen Personen teilen. Er wird damit zu einem Werkzeug, einer Erweiterung oder Verstärkung für den Besitzer (Bendel 2025c). Genau hier entsteht der Bedarf an Forschung – Forschung, die bisher kaum stattgefunden hat. Es muss dargelegt werden, welche Anwendungsbereiche entstehen und welche Chancen und Risiken vorhanden sind. Daraus sind wiederum Überlegungen für die Entwicklung oder Weiterentwicklung tragbarer sozialer Roboter abzuleiten.

Der vorliegende Beitrag widmet sich Wearable Social Robots als Werkzeugen und Erweiterungen oder Verbesserungen, im Sinne einer ersten Grundlegung und Ausdeutung. Die Forschungsfrage lautet: Was sind Wearable Social Robots, wie können sie eingesetzt werden, welche sozialen und ethischen Implikationen bestehen und wie können diese abgemildert werden? Abschnitt 2 definiert, was Wearable Social Robots sind, ausgehend von Wearable Robots, und nennt mehrere Beispiele. Abschnitt 3 führt mögliche Anwendungsbereiche auf und ordnet sie ein. Abschnitt 4 stellt soziale und ethische Herausforderungen dar, anhand der zuvor gewonnenen Klassifikation. Abschnitt 5 baut darauf auf und formuliert Empfehlungen für Entwickler und Benutzer, auch in Hinblick auf die skizzierten Folgen. Am Ende stehen Zusammenfassung und Ausblick.

Weiterlesen mit Login

Noch nicht registriert?

Registrieren Sie sich jetzt kostenfrei und Sie erhalten vollen Zugriff auf alle exklusiven Beiträge. Mit unserem Newsletter senden wir Ihnen Top-Meldungen aus der Automatisierung, Bildverarbeitung und Licht- und Lasertechnik im Industrieumfeld. Außerdem erhalten Sie regelmässig Zugriff auf unsere aktuellen E-Paper.

RegistrierenMeist gelesen

Die Zukunft der Intralogistik

Die Intralogistik befindet sich im Wandel: Der Bedarf an qualifizierten Fachkräften steigt, während gleichzeitig neue Konzepte und Technologien entstehen.

Mehr Kreislauf durch PCR-Spouts

Standbodenbeutel mit Ausgießer kommen in immer mehr Anwendungen zum Einsatz. Setzen Hersteller auf Monomaterial-Konzepte, lassen sich Verpackungen besser recyceln und in den Kreislauf zurückführen.

Wie klassische KI-Systeme intelligenter werden

Vom maschinellen Sehen zur maschinellen Wahrnehmung

Industrielle Qualitätsprüfung mit Contact-Image-Sensoren

Für die Qualitätsprüfung flacher Objekte oder Endlosmaterial sind Contact-Image-Sensoren eine Alternative zu Zeilenkameras. Rauscher erweitert sein Portfolio um Insnex-CIS-Module mit bis zu 3.600 DPI.

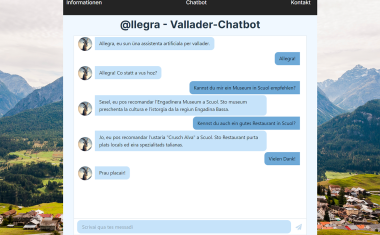

Chatbots für tote, gefährdete und ausgestorbene Sprachen

Möglichkeiten und Grenzen generativer KI für die Weiterbildung.