Kombination mit Zukunft: KI und Embedded Vision

Ausblick: Welche Anwendungen mit Künstlicher Intelligenz und Embedded Vision möglich sind und sein werden

Wenn Bildverarbeitungsanwendungen immer in einer kontrollierten Umgebung durchgeführt würden, z.B. in Innenräumen mit einheitlichen Beleuchtungen, Formen und Farben, wäre der Einsatz von KI kaum erforderlich. Doch Bildverarbeitung wird häufig in unkontrollierten Umgebungen wie Traffic-Anwendungen oder industriellen Umgebungen, wo Objekte mit unterschiedlichen Formen und Farben die Norm und nicht die Ausnahme sind, genutzt. KI-Systeme tolerieren Schwankungen der Umgebungsbeleuchtung, des Betrachtungswinkels, Einflüsse wie Regen, Staub, verdeckte Objekte und andere Umgebungsfaktoren. Wenn zum Beispiel über 24 Stunden hinweg Autos auf einer Straße erfasst werden, ändern sich die Beleuchtungs- und Bildaufnahmewinkel ständig. Ein weiteres Beispiel: Sie sind Tomatenproduzent und müssen jeweils drei Tomaten in einer Verpackung bündeln, um sie an Lebensmittelgeschäfte zu verteilen. Die Tomaten müssen in Form und Farbe möglichst einheitlich sein, um die Qualitätskontrollstandards des Abnehmers zu erfüllen. Nur ein KI-basiertes Bildverarbeitungssystem kann die starken Form- und Farbvariationen unterscheiden und diejenigen Tomaten identifizieren, die so rund und rot sind, wie der Kunde es wünscht. Wie erreicht man dieses Ziel, wenn man kein Experte für KI oder Bildverarbeitung ist?

GUI zum Trainieren neuronaler Netze für 2D-Objekte

Es ist keine Jahrzehnte, sondern nur wenige Jahre her, seit KI-Tools mit einer grafischen Benutzeroberfläche (GUI) verfügbar sind, um neuronale Netze auf 2D-Bildern zu trainieren. Vor dieser Errungenschaft hätte das Training neuronaler Netze für die Bildverarbeitung und Inspektion oder für intelligente Transportplattformen ein umfassendes Fachwissen in den Bereichen KI/maschinelles Lernen und Datenwissenschaft erfordert und wäre eine kostspielige und zeitaufwändige Investition für jedes Unternehmen gewesen. Doch die KI-Tools haben sich inzwischen erheblich verändert.

Worauf muss man bei einem GUI-Tool für KI achten?

- Flexibilität: Der Anwender sollte ein GUI-Tool auswählen, mit dem er eigene Bildbeispiele einbringen und neuronale Netze trainieren kann, um Aufgaben wie Klassifizierung, Objekterkennung, Segmentierung und Rauschunterdrückung durchzuführen, damit er die Vorteile einer größeren Flexibilität und Anpassung nutzen kann.

- Lokalität: Der Anwender sollte ein Tool verwenden, mit dem er seine Trainingsdaten auf seinem PC modellieren kann, ohne eine Verbindung zur Cloud herzustellen. So ist ein hohes Maß an Datenschutz sichergestellt.

- Inferenz exportieren: Tool, mit dem Modelldateien in ein Inferenz-Tool exportiert werden können, um es im Live-Videostream auszuführen

- Intuitive Gestaltung des GUI: Visualisieren der Modellleistung mit numerischen Kennzahlen und Heat Maps

- Nutzung vortrainierter Modelle: Minimierung des Schulungsaufwandes durch Verwendung vortrainierter Modelle, die mit dem Softwarepaket geliefert werden.

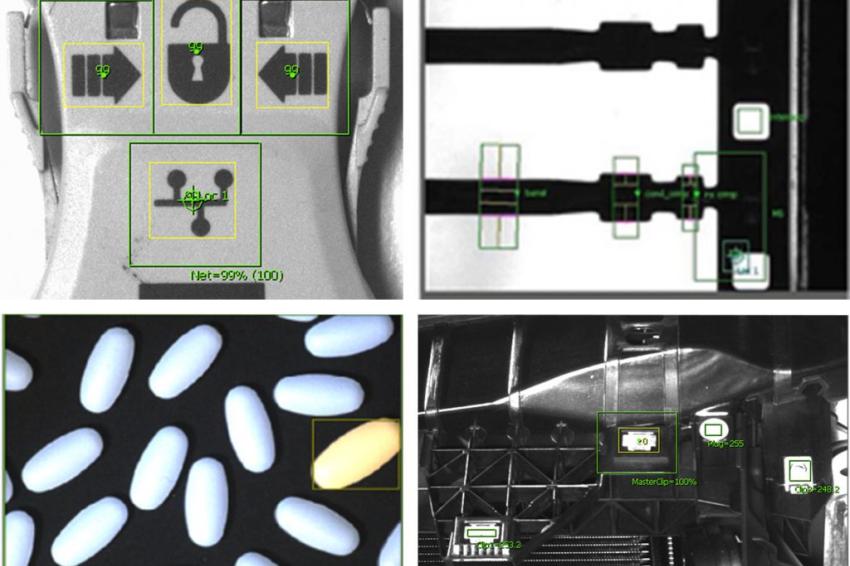

Betrachten wir als konkretes Beispiel die Aufgabe, bestimmte Hardwareteile wie Muttern, Schrauben, Nägel und Unterlegscheiben zu lokalisieren und zu identifizieren. Diese Teile liegen jedoch gemeinsam mit einer Vielzahl bunter Markierungen auf einer reflektierenden Oberfläche. Mit herkömmlicher Bildverarbeitung wäre es sehr zeitaufwändig, die erforderliche Robustheit für diese Aufgabe zu erreichen. Im Gegensatz dazu erfordert ein KI-Tool mit einem geeigneten Objekterkennungsalgorithmus nur das Antrainieren von ein paar wenigen Dutzend Beispielen. Mit einem solchen Software-Tool können Anwender schneller und einfacher ein robustes und genaues System zur Lageerkennung und Identifikation erstellen, wodurch die Entwicklungszeit und die damit verbundenen Kosten reduziert werden.

Intelligente Transportsysteme (ITS) eignen sich ebenfalls für den Einsatz von KI-basierten Bildverarbeitungssystemen. Von der Maut-Verwaltung über die Kontrolle der Verkehrssicherheit bis hin zur Geschwindigkeits- und Rotlichtüberwachung kann KI-Software verwendet werden, um Fahrzeuge und andere sich bewegende und stationäre Objekte mit hoher Genauigkeit zu lokalisieren, zu segmentieren und zu identifizieren.

Entwicklung eines KI-basierten Software-Tools

Beim Einsatz eines KI-basierten Software-Tools gibt es einige wichtige Schritte im Entwicklungsprozess zu beachten. Zuerst müssen die Daten erstellt werden, danach erfolgt die Bearbeitung und Veränderung des Datensatzes. Zu Beginn erfolgt das Erfassen von Trainingsbildern und deren manuelle Zuordnung zu den Objekten. Im Allgemeinen importiert man diese Bilder aus externen Quellen oder über ein Netzwerk auf den PC. Bei diesem Prozess ist es wichtig zu beachten, dass die Qualität des gesamten Modells von der Qualität der einzelnen Datensätze im Modell abhängt. Wichtig ist zudem der Einsatz einer GPU mit ausreichender Rechenleistung, um die eigentliche Bildverarbeitung durchzuführen. Im nächsten Schritt erfolgt die Berechnung der Daten auf einem Trainings-Rechner, um das Datenmodell zu erstellen.

Anschließend müssen anhand der Ergebnisse Modelltests durchgeführt werden. Dieser Schritt beinhaltet die Verwendung einer Matrix zur Anzeige von falsch positiven und falsch negativen Ergebnissen, die als Basis für die Visualisierung einer Heat Map dient, mit der die Aktivierung des neuronalen Netzwerks angezeigt wird. Sobald das Modell ausreichend trainiert und getestet ist, kann es zum Einsatz in der geplanten Bildverarbeitungsanwendung exportiert werden.

Plug & Play mit Embedded Vision

Der Begriff Embedded Vision erlaubt viele unterschiedliche Interpretationen. Es stehen Variationen dieser Technologie zur Verfügung, die auch Embedded-Vision-Plattformen mit integrierter KI umfassen. Jeder Anwender sollte die möglichen Optionen (einschließlich der Kosten) genau abwägen, bevor er sich für ein System entscheidet. Ein Embedded-Vision-System kann aus einer Kamera mit einem Embedded- oder FPGA-Prozessor, einem programmierbaren Bildsensor, einer intelligenten Kamera oder einem handelsüblichen PC-System mit einer flexiblen Embedded-Anwendung bestehen. Embedded-Vision-Anwendungen zeichnen sich in der Regel durch eine geringe Größe, ein geringes Gewicht und eine geringe Leistungsaufnahme aus.

Sie ermöglichen zudem eine Reduktion der Daten zwischen Kamera und Host-PC und somit ein geringeres Datenvolumen bei der Datenübertragung. Weitere Vorteile sind die Reduzierung von Kosten, da für Embedded-Vision-Anwendungen keine teuren GPU-Karten in einem PC erforderlich sind sowie die bekannte Leistungsfähigkeit, der Betrieb im Offline-Modus, für den keine Netzwerkverbindung erforderlich ist, und die einfache Einrichtung. Wer nach einem Komplettsystem sucht, das einfach einzurichten und vor Ort bereitzustellen ist, findet in Embedded-Vision-Systemen häufig eine geeignete Lösung mit vielen Vorteilen.

Embedded Vision ist gut für industrielle Anwendungen wie beispielsweise die Erkennung von Fehlern oder für Identifikationsaufgaben geeignet. In der Praxis sind das unter anderem folgende Aufgabenstellungen:

Fehlererkennung

- Mustervergleiche zur Prüfung auf Anwesenheit oder Position,

- Erkennen und Zählen von vorhandenen oder fehlenden Merkmalen,

- Vermessen von Merkmalen oder Teilen,

- Farbprüfung von Teilen oder Baugruppen.

Identifikation

- Produktüberprüfung: Lesen von Produktcodes, um Verwechslungen bei der Kennzeichnung zu vermeiden.

- Überprüfung von Kennzeichnungen, z. B. von Produkttypen, Chargennummern oder Datumscodes,

- Qualitätsprüfung von Markierungen, Etikettenpositionen oder dem Vorhandensein bzw. Fehlen von Merkmalen,

- Montageüberprüfung, um die Historie in jeder Phase der Herstellung verfolgen zu können.

- Logistik: Sicherstellen des ordnungsgemäßen Ablaufs vom Wareneingang über die Kommissionierung bis hin zu Sortierung und Versand.

Unabhängig davon, ob sie einzeln oder zusammen eingesetzt werden, markieren KI- und Embedded-Vision-Systeme einen Entwicklungssprung in der digitalen Bildverarbeitung. Beispielsweise können Verkehrsüberwachungssysteme, mit denen die Beachtung roter Ampeln und die Einhaltung von Geschwindigkeitsbegrenzungen überwacht werden, Embedded-Bildverarbeitungssysteme nutzen, um Bilder so effizient wie möglich zu erfassen. Anschließend sorgen KI-basierte Systeme dafür, dass die Auswertung der aufgenommenen Bilder auch bei wechselnden Wetter- und Lichtverhältnissen zuverlässig erfolgt. Regnet oder schneit es? Scheint das Licht hell oder dunkel? Mit KI-Implementierungen kann das System auf die unkontrollierbaren Bedingungen des realen Lebens reagieren.

Was ist die Zukunft?

Durch den Einsatz von KI und Embedded Vision kann die nächste Generation digitaler Bildverarbeitungssysteme feststellen, wie viele Fahrgäste in einem Auto sitzen, ob Personen während des Fahrens Mobiltelefone nutzen oder ob Fahrer und Beifahrer angeschnallt sind. Dieses erhöhte Intelligenzniveau ermöglicht mehr Sicherheit im Straßenverkehr. Weiterentwicklungen bei der Bilderfassung und -verarbeitung sowie in der Softwaretechnologie und bei intelligenten Kameras sind maßgeblich für die Fortschritte der KI-basierten Bildverarbeitung und bei Embedded-Vision-Systemen verantwortlich. Die Bedeutung von dezentraler KI-Rechenleistung vor Ort ist jedoch auch nicht zu unterschätzen, denn Kosten und Bandbreite lassen sich reduzieren, wenn große Datenmengen nicht kontinuierlich zur Verarbeitung über ein Netzwerk gesendet werden müssen. Dies führt zudem zu einer geringeren Latenz, zu mehr Datenschutz und zu einer verbesserten Leistung von Anwendungen.

All das ist jedoch erst der Anfang dessen, was mit diesen neuen Bildverarbeitungstechnologien möglich sein wird. Schon bald werden Anlagen im Feld „kontinuierlich Lernen“ können und ihre Leistung damit im Einsatz und während der Laufzeit automatisch perfektionieren. Diese flexible Anpassung vorhandener Modelle an wechselnde Randbedingungen durch den Einsatz kontinuierlicher Lernprozesse gibt Entwicklungsteams neue Freiheiten und erspart diesen viel Zeit, die bisher für das Nachtrainieren von Modellen erforderlich war.

Ein gutes Beispiel für diesen Ansatz ist eine Drohne, die zur Verkehrsüberwachung in mehreren Höhen fliegen soll: Es genügt zum Anlernen eines Basismodells, zunächst nur Bilder zu trainieren, die in einer einzigen Höhe (z. B. aus 10 Metern) aufgenommen wurden. Nach dem Einsatz vor Ort wird anschließend der Algorithmus für kontinuierliches Lernen aktiviert und das Modell angepasst, wenn die Drohne in anderen Höhen fliegt. Ohne kontinuierliches Lernen müsste das Modell für jede neue Flughöhe der Drohne neu trainiert werden, um die erforderliche Genauigkeit zu erzielen. Beim Einsatz von KI reagiert das Modell jedoch selbständig auf Veränderungen der Fahrzeuggrößen und -entfernungen sowie auf unterschiedliche Blickwinkel. Diese Art des Lernens von Bildverarbeitungssystemen während des Einsatzes verbessert die Anwendungsfunktionalität erheblich.

Autor:

Bruno Ménard,

Software Director, Teledyne Dalsa, Vision Solutions