Sicher Arbeiten mit KI-gestützter Echtzeit-Helmerkennung

Embedded-Vision-Lösung erhöht die Sicherheit auf der Baustelle

Das Baugewerbe gehört zu den gefährlichsten Branchen in den USA. Im Laufe der Jahre hat sich die persönliche Schutzausrüstung aufgrund ihrer Bedeutung für die Sicherheit der Arbeiter zu einer obligatorischen Anforderung auf Baustellen entwickelt. Zur Schutzausrüstung gehören Schutzbrillen, Gehörschutzstöpsel, Handschuhe und Helme. Der technologische Wandel in der Fertigung umfasst die Integration dieser Gegenstände in das Internet der Dinge (IOT), um besser zu verstehen, wie die Ausrüstung verwendet wird, um sofort handeln zu können, falls es erforderlich ist, zum Beispiel durch eine Warnung, wenn ein Arbeiter eine Sperrzone betritt, um potenzielle Gefahren zu vermeiden.

Das IOT wird in diesem Bereich durch künstliche Intelligenz (KI) ergänzt. Angesichts der Fortschritte bei den Deep-Learning-Algorithmen und der immensen Datenmengen, die täglich anfallen, haben die KI-Techniken viele neue Aufgaben und Umgebungen erschlossen, sodass sie mittlerweile in zahlreichen Branchen zum Einsatz kommen.

Auch die Bildverarbeitung hat in den letzten Jahren enorme Fortschritte gemacht. Auf Baustellen kann diese Technologie zum Beispiel sicherstellen, dass die Arbeiter ihre persönliche Schutzausrüstung tragen. Diese zu tragen ist essenziell, um die Risiken für die Gesundheit der Arbeiter und die Verantwortung des Arbeitgebers zu minimieren.

Tryolabs ist eine Partnerschaft mit Seeed eingegangen, Hersteller einer Hardware-Plattform, die eng mit Technologieanbietern aller Größenordnungen zusammenarbeitet und hochwertige, erschwingliche Hardware anbietet. Zum Portfolio gehören unter anderem Nvidia-Produkte auf ihrer Jetson-Plattform. Das Ziel war es, die Hardware von Seeed zu nutzen, vor allem die mit dem Jetson-Xavier-NX-8-GB-Modul gebauten Recomputer Edge-Geräte, und eine Computer-Vision-Analyselösung zu entwickeln, die eine anspruchsvolle Aufgabe löst: Sicherheitshelme in Echtzeit zu erkennen.

Die manuelle Kontrolle des Tragens von Schutzhelmen ist sehr teuer

Speziell im Baugewerbe tragen Schutzhelme dazu bei, Verletzungen zu vermeiden oder zumindest zu minimieren. Die Unternehmen wollen alle Arten von Verletzungen vermeiden, insbesondere Kopfverletzungen. Diese können zu unheilbaren, langfristigen gesundheitlichen Komplikationen führen, wie Gedächtnisverlust, Knochenbrüche und Wirbelsäulenschäden. Im Jahr 2012 waren mehr als 65.000 Arbeitsunfähigkeitstage auf Kopfverletzungen am Arbeitsplatz zurückzuführen. Im selben Jahr starben 1.020 Arbeitnehmer an Kopfverletzungen bei der Arbeit. In den meisten Ländern der Welt ist daher die Verwendung von Schutzausrüstungen wie Helmen vorgeschrieben.

Viele Arbeitnehmer sind sich jedoch nicht darüber im Klaren, wie gefährlich es ist, nicht die richtige Ausrüstung zu tragen. Aus vielen Gründen – sei es, dass es zu heiß oder zu kalt ist oder dass der Helm unbequem ist – neigen Arbeitnehmer dazu, ihren Helm abzunehmen, obwohl sie Gefahr laufen, sich zu verletzen.

Leider gibt es Unzulänglichkeiten beim kontinuierlichen Überwachen, ob die eigenen Mitarbeiter ihren Helm tragen, weshalb die Unternehmen Mühe haben, sicherzustellen, dass alle die Sicherheitsvorschriften einhalten. In den meisten Fällen wird manuell kontrolliert, was sehr teuer und ineffizient ist.

In der Regel müssen bei der manuellen Kontrolle reaktive Maßnahmen ergriffen werden. Aus Unternehmenssicht wären erhebliche Kostensenkungen möglich, wenn die mit der Überwachung und Kontrolle der Baustellen betrauten Personen proaktive Maßnahmen ergreifen könnten. Die derzeitige Technologie weckt die Neugier, angesichts unserer vorhandenen Möglichkeiten und Ressourcen nach besseren Alternativen zu suchen und diese zu erforschen. Genau hier setzt die neue Lösung an.

Wie könnte KI zur Verbesserung des Geschäftsprozesses eingesetzt werden?

Nachdem wir das Problem hinter dem Anwendungsfall verstanden hatten, entwarf und implementierte Tryolabs die Technologieplattform. Die vorgeschlagene Lösung umfasst ein robustes System in der Produktion, das eingebettete Hardware, optimierte Computer-Vision-Software und Datenanalysetools verwendet. Die Kombination dieser Technologien ermöglicht es dem Unternehmen, den Prozess der Überwachung vollständig zu automatisieren, indem es Echtzeitstatistiken über die Aktivitäten auf der Baustelle erhält.

Durch die Zusammenarbeit mit Technologieanbietern, von der Hardware bis zur Cloud, bietet Seeed eine breite Palette von Hardware-Plattformen und Sensormodulen, die sich in bestehende IOT-Plattformen integrieren lassen. Der Plan besteht darin, eine End-to-End-Lösung zu entwickeln, um die Verwendung von Sicherheitshelmen in Echtzeit zu überwachen und sie auf einem von Seeed bereitgestellten Jetson-Xavier-NX-Modul einzusetzen. Auf diese Weise stellt Tryolabs die Bildverarbeitungssoftware zur Verfügung, und Seeed liefert alle für die Bereitstellung der Lösung erforderlichen Endgeräte.

Lösung: eine Echtzeit-Videoanalyseplattform

Der Jetson Xavier NX ist ein kleines, aber leistungsstarkes Modul, das sich für KI-Anwendungen in Embedded- und Edge-Geräten eignet. Es ist mit einer 384-Kern-Nvidia-Volta-GPU, einer 6-Kern-Carmel-ARM-CPU und zwei Nvidia Deep Learning Accelerators (NVDLA) ausgestattet. Er erreicht eine KI-Leistung von 21 TOPS bei einem Stromverbrauch von 20 W (oder 14 TOPS im Low-Power-Modus bei einem Stromverbrauch von 10 W). Diese Spezifikationen in Kombination mit dem 8-GB-LPDDR4x-Speicher mit einer Bandbreite von 59,7 GB/s machen dieses Modul zu einer geeigneten Plattform für KI-Netzwerke mit beschleunigten Bibliotheken für Deep Learning und Computer Vision.

Ein KI-Modell wurde trainiert, um den Einsatz von Sicherheitshelmen kontinuierlich zu überwachen

Yolov5 ist einer der am häufigsten verwendeten Algorithmen zur Objekterkennung. Er ist schnell und genau, sodass seine Nutzer Anwendungen zur Objekterkennung in Echtzeit erstellen können. Seit seiner Veröffentlichung im Jahr 2016 durch Joseph Redmond ist der Yolo-Algorithmus für seine Leistung bekannt. Seine geringe Größe ebnete den Weg für mobile Geräte. Yolov5 ist etwa 88 Prozent kleiner als Yolov4. Wenn Yolov5 auf einem Nvidia-Tesla-P100-Grafikprozessor ausgeführt wird, kann es Objekte mit 140 FPS erkennen, verglichen mit der maximalen Fähigkeit seines Vorgängers von 50 FPS.

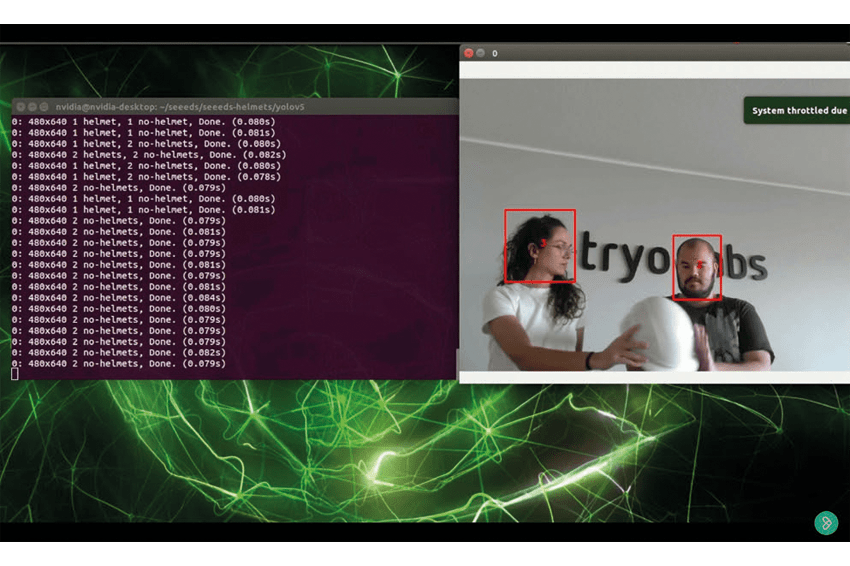

Eine Yolov5-Medium-Architektur wurde trainiert, um die Verwendung von Sicherheitshelmen auf Baustellen und in Fabriken kontinuierlich zu überwachen. Das Erkennungssystem kann die Gesichter der Personen auf einem Bild lokalisieren und sie in die Kategorien „mit Helm“ und „ohne Helm“ einteilen. Bei einer bestimmten Person auf einem Video sollte diese Kategorie durch aufeinanderfolgende Videobilder hoch korreliert sein. Tryolabs‘ Open-Source-Tracking-Bibliothek Norfair ermöglicht es, robustere und weniger verrauschte Kriterien für diese Klassifizierung zu erhalten. Durch die Nutzung des Video-Trackings haben wir ein Votingsystem implementiert, das die Kennzeichnung mehrerer aufeinanderfolgender Erkennungen verwendet, um mit größerer Sicherheit entscheiden zu können, ob eine Person einen Helm trägt oder nicht. Für die Klassifizierung jeder Person sind daher Beweise für mehrere Bilder erforderlich. Eine einzige falsche Erkennung reicht nicht aus, um die Kategorie zu ändern, in die eine Person eingeordnet wird.

Das Modell kann Muster lernen, die sich gut verallgemeinern lassen

Täglich werden Quintillionen von Bytes an Daten erzeugt, und KI-Modelle machen sich dies zunutze. Die Anzahl der Bilder, die täglich ins Internet hochgeladen werden, hat öffentliche Datensätze für viele Anwendungen ermöglicht. Natürlich ist der Zugang zu diesen Bildern nicht die einzige Voraussetzung, um einen Datensatz zu erzeugen. Wenn man mit Supervised Learning arbeitet, braucht man auch Zeit und menschlichen Einsatz, um jedes Bild mit den richtigen Kommentaren zu versehen, damit die Computer die Muster erkennen, die sie lernen sollen. Um ein Erkennungssystem zu entwickeln, das für die verschiedenen Umgebungen gut funktioniert, müssen die Bilder dieses Datensatzes an vielen verschiedenen Orten und unter unterschiedlichen Lichtverhältnissen aufgenommen werden. Im Gegenzug kann das Modell Muster lernen, die sich gut verallgemeinern lassen, im Gegensatz zu Merkmalen, die nur für eine bestimmte Szene gelten.

Glücklicherweise gibt es bereits öffentliche Datensätze zur Unterscheidung von Gesichtern mit und ohne Helm, wie zum Beispiel den GDUT-Hardhat-Wearing-Detection-Datensatz, den wir für dieses Projekt ausgewählt haben. Dieser Datensatz umfasst 3.869 Bilder, von denen eine Teilmenge von 2.916 Bildern für den Trainingssatz ausgewählt wurde. Weitere 635 Bilder wurden für die Validierung verwendet und die restlichen 318 Bilder blieben für Testzwecke übrig.

Yolov5 vs. Faster R-CNN

Wir haben die Yolov5- und die Faster-R-CNN-Architekturen in einem Trainingsauftrag mit diesem Datensatz und den meisten Standardeinstellungen verglichen. Das Training bestand aus 26 Durchläufen mit Multiprocessing und zwei Nvidia GeForce RTX 2080 Ti GPUs. Yolov5 übertraf Faster R-CNN bei weitem, da es in viel kürzerer Zeit bessere Metriken erzielte. In Bezug auf die Inferenzzeit zeigten beide Modelle eine ähnliche Leistung und benötigten etwa 0,08 s für jedes Bild auf dem Edge-Gerät (12,5 FPS).

Schlussfolgerungen

Die Überwachung der Helmnutzung in verschiedenen Szenarien führt zu wertvollen Erkenntnissen, um vorbeugende Maßnahmen zu ergreifen und Zeit sowie Ressourcen zu sparen. Tryolabs hat ein Erkennungssystem entwickelt, das mit einem Edge-Device in verschiedenen Umgebungen eine effizientere und erschwinglichere Alternative zum manuellen Prozess ist.

Autor

Nicolás Eiris, Lead Machine Learning Engineer