Neuromorphe Sensortechnologie

26.06.2025 - Event-basierte Bildgebung erfasst Bewegungsabläufe

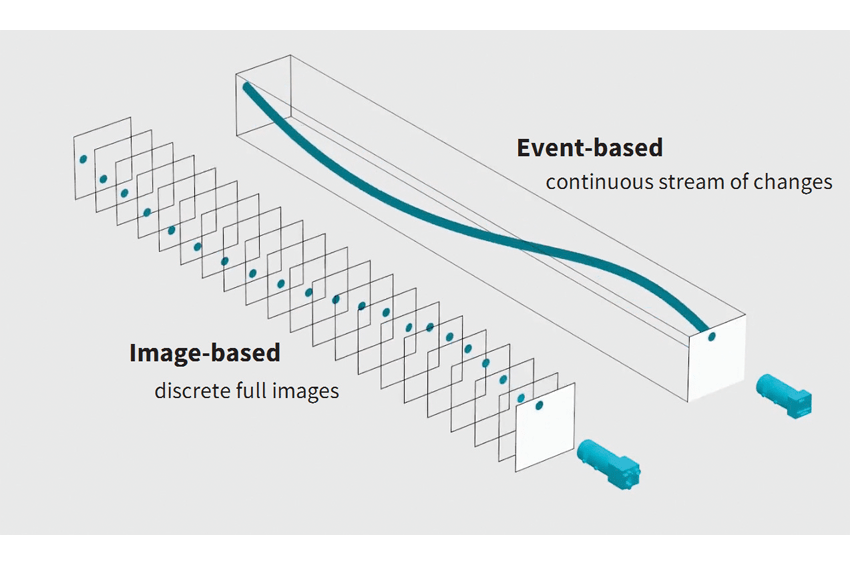

Das Erfassen und Auswerten schneller Bewegungen ist eine Herausforderung in der Bildgebung. Highspeed-Kameras mit großer Sensorauflösung und hohen Bildraten liefern detaillierte Informationen, erzeugen jedoch enorme Datenmengen. Dabei werden viele statische, oft irrelevante Bilddaten an den Host-PC übertragen und aufwändig verarbeitet. Sogenannte Event-basierte Vision-Sensoren (kurz: EVS) verfolgen einen neuen Ansatz: Statt eine Flut an redundanten Bildinformationen zu erzeugen, detektieren sie die Pixel-Veränderungen über die Zeit. Das Ergebnis sind zeitbasierte Bewegungsinformationen.

Bei der Event-basierten Bildgebung spricht man auch von neuromorpher Sensortechnologie – also Sensoren, die Informationen ähnlich wie das menschliche Nervensystem verarbeiten. Der evolutionäre Vorteil unseres Gehirns liegt nicht nur in der effizienten Verarbeitung großer Datenmengen, sondern vor allem in der Reaktion auf Veränderungen, wie Helligkeit, Kontraste und Bewegungen. Gleichmäßige Reize werden weitgehend ignoriert. Dadurch konzentrieren sich Menschen auf relevante Veränderungen, statt statische Details permanent neu zu erfassen.

Genau diese Fähigkeit bildet Prophesee in Kooperation mit Sony nach: Die gemeinsam entwickelte Pixelelektronik detektiert ausschließlich Veränderungen. Sobald der Kontrast eines Pixels einen Schwellenwert überschreitet, wird in Echtzeit ein sogenanntes Change-Event ausgelöst, unabhängig von seinen Pixel-Nachbarn. Der Sensor arbeitet nicht in gleichmäßigen Zeitabständen, sondern reagiert auf Veränderungen mit einer zeitlichen Auflösung von bis zu einer Mikrosekunde. Vergleichbar mit einer Framerate von über 10.000 Bildern pro Sekunde lassen sich Bewegungen mit Event-basierten Kameras nahezu lückenlos erfassen.

Datenübertragung nur bei Veränderungen

Während bildbasierte Kameras stets die vollständige Datenmenge der gesamten Sensorfläche in gleichmäßigen zeitlichen Abständen übertragen, erzeugt eine Event-basierte Kamera im gleichen Zeitraum deutlich weniger Daten. So müssen Anwendungsentwickler bei der Erfassung schneller Ereignisse keine Kompromisse zwischen hoher Bildrate und redundanter Datenmenge eingehen. Die erzeugte Datenmenge hängt direkt von der Aktivität im Sichtfeld ab und passt sich automatisch an veränderte Szenenbedingungen an. Im Gegensatz zu klassischen Sensoren senden EVS-Pixel nur dann Daten, wenn sich tatsächlich etwas im Bild verändert.

Bei schnellen Bewegungen erzeugen klassische Sensoren häufig Bewegungsunschärfe, da sich Objektkanten während der Belichtung über mehrere Pixel hinweg bewegen. Je schneller das Objekt oder je länger die Belichtungszeit ist, desto unschärfer wird das Bild. EVS-Pixel hingegen analysieren das Licht kontinuierlich und registrieren nur Änderungen der Helligkeit. Überschreitet die Lichtmenge definierte Schwellwerte, erzeugen sie On- oder Off-Events. So lassen sich schnelle Bewegungen pixelgenau erfassen – ohne Bewegungsunschärfe, als hochaufgelöster Stream einzelner Ereignisse.

Weniger Daten, effizientere Information

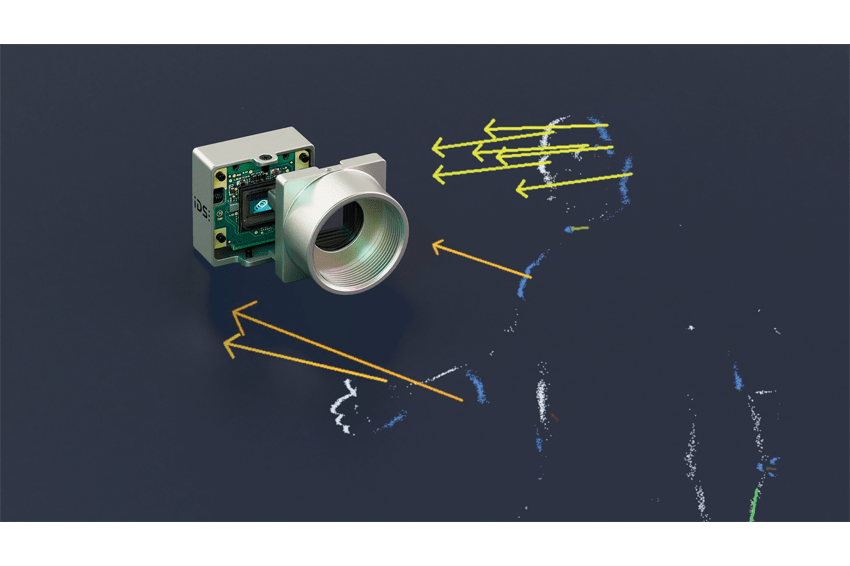

Die nativen EVS-Daten (Pixelposition X/Y, On/Off-Polarität, Zeitstempel T), sind kompakt und effizient – ideal für maschinelle Verarbeitung, aber weniger intuitiv für den Menschen. Zur Darstellung lassen sich die Event-Daten in vollständige Bilder überführen, die insbesondere Kanten hervorheben, da Kontraständerungen typischerweise an Objektgrenzen entstehen.

Da nur relevante Daten erfasst werden, verringern sich der Speicherbedarf und Verarbeitungsaufwand deutlich. Aus den Zeitdifferenzen der Events lassen sich Bewegungsrichtung und -geschwindigkeit unmittelbar berechnen, ohne auf klassische Bildanalyse oder das Herausfiltern unbewegter Bereiche angewiesen zu sein. Die geringe Datenmenge ermöglicht Echtzeitanalysen und vereinfacht Mehrkamerasysteme, da man mit deutlich geringerem technischem Aufwand auskommt.

Zeit als Information

Dank mikrosekundengenauer Zeitstempel, der Position einzelner Pixelevents sowie die Erfassung von Änderungsereignissen lassen sich neue Anwendungen erschließen, bei denen herkömmliche Kameras mit fester Bildrate aufgrund der hohen Datenmengen an ihre Grenzen stoßen. Ein Beispiel sind Slow-Motion-Aufnahmen.

Indem die erfassten Pixelevents in ein zeitliches Raster akkumuliert und daraus vollständige Sensorbilder generiert werden, entstehen Zeitlupenvideos mit einer variablen „Belichtungszeit“. Die Wiedergabe-Geschwindigkeit bleibt durch die gewählte Akkumulationszeit und Anzeigeframerate auch nachträglich variabel – von Echtzeit (Superzeitlupe mit einem Bild pro Event) über tatsächliche Bewegungsgeschwindigkeit (circa ein Bild pro 33 ms) bis hin zu einem Standbild. Fasst man darin alle erfassten Events (zeitlich) zusammen, wird der vollständige Bewegungsverlauf sichtbar.

Für eine präzise, numerische Analyse von Objektbewegungen lassen sich auch Geschwindigkeits- und Richtungsinformationen ohne aufwändige Bildverarbeitung extrahieren. Visualisiert man hingegen Ort und Zeit mehrerer Pixel-Ereignisse über einen bestimmten Zeitbereich in einer 3D-Darstellung, entsteht eine qualitative Darstellung des Bewegungsverlaufs. Anwendung findet dieses Vorgehen beispielsweise bei der Strömungsanalyse zur präzisen Erfassung der Bewegung von Flüssigkeiten und Gasen.

Asynchrone Datenverarbeitung

Um die Potenziale der Event-Daten auszuschöpfen, müssen Entwickler von klassischen Bildzyklen auf eine asynchrone Datenverarbeitung umdenken. Zwar können Events in klassische Frames umgewandelt werden, doch das reduziert die Vorteile der Dynamik, Präzision und Effizienz. Erforderlich sind spezialisierte Tools und Algorithmen. Diese findet man heute jedoch in keinem der bekannten, bildbasierten Standard Vision Frameworks.

Prophesee und Sony stellen mit dem Metavision SDK passende Werkzeuge, Dokumentation und Beispielprojekte bereit. Damit können Anwender sofort starten, um sich die neuen Möglichkeiten dieser Technologie schnell nutzbar zu machen.

Anwendung in der Qualitätssicherung

Die Fähigkeiten neuromorpher Sensoren bieten großes Potenzial für die Qualitätssicherung, insbesondere dort, wo Genauigkeit, Geschwindigkeit und Effizienz bei der Fehlererkennung gefragt sind. Der Mehrwert, kleinste Objekt- und Materialveränderungen in Pixelgröße und Echtzeit erfassen zu können, zeigt sich beispielsweise bei der Überwachung von Maschinen und Prozessen. Durch die hohe zeitliche Auflösung bis in den Mikrosekundenbereich sind sogar hochfrequente Bewegungen, wie Vibrationen oder akustische Signale, visualisierbar. Analysen decken frühzeitig ungewöhnliche Muster auf, die zu Schäden oder Produktionsausfällen führen können.

Da sie nur Bewegungen oder Kontraste wahrnehmen, sind neuromorphe Sensoren wesentlich unempfindlicher gegenüber wechselnden Lichtverhältnissen (Reflexionen oder Schatten) und klassischen Bildverarbeitungssystemen in dieser Hinsicht überlegen. Besonders bei der schnellen Fehlererkennung, Prozessüberwachung oder Inspektionen unter schwierigen Bedingungen spielen sie ihre Stärken aus.

Fazit

Event-basierte Sensoren erfassen keine vollständigen Bilder, sondern lediglich Pixel-Veränderungen über die Zeit. Daraus lassen sich dynamische Visualisierungen erzeugen, die weit mehr Bewegungsinformationen liefern als klassische Bildsensoren allein. Sie stehen daher nicht in Konkurrenz zu herkömmlichen Kameras oder KI-basierter Bildverarbeitung, sondern ergänzen diese sinnvoll – insbesondere bei schnellen Bewegungsanalysen, industriellen Qualitätssicherungsaufgaben sowie in der Robotik und für autonome Systeme.